Tạo ‘bản sao’ bằng deepfake để họp trực tuyến

Người không biết ngoại ngữ có thể dùng “ bản sao” tạo từ deepfake và tính năng dịch để trao đổi bằng ngôn ngữ mẹ đẻ của khách hàng.

Deepfake thường được nhắc đến với những mặt trái, nhưng theo Wired , công nghệ này cũng có thể giúp làm việc từ xa trở nên bớt nhàm chán và khiến các cuộc họp qua Internet thú vị hơn.

Một số nhân viên của công ty kiểm toán EY đang thử nghiệm một công cụ giao tiếp mới. Họ minh họa cho bài thuyết trình của mình bằng các clip với sự tham gia của avatar y hệt bản thân. Hoặc khi trao đổi với khách hàng ở Nhật Bản, họ sử dụng “bản sao” AI của mình cùng chức năng dịch ngôn ngữ theo thời gian thực để tương tác với khách hàng bằng tiếng mẹ đẻ của họ.Việc này được thực hiện bằng công nghệ deepfake.

Công cụ áp dụng tại EY do startup Synthesia ở Anh cung cấp. Synthesia chứng tỏ được tiềm năng khi đại dịch làm ảnh hưởng nghiêm trọng đến cách thức giao tiếp truyền thống. Ở nhiều nơi, chơi golf hay dùng bữa trưa tại nhà hàng đã trở thành điều gần như không thể. Thay vào đó, các cuộc gọi qua zoom và tài liệu PDF trở thành chuyện thường ngày.

Video đang HOT

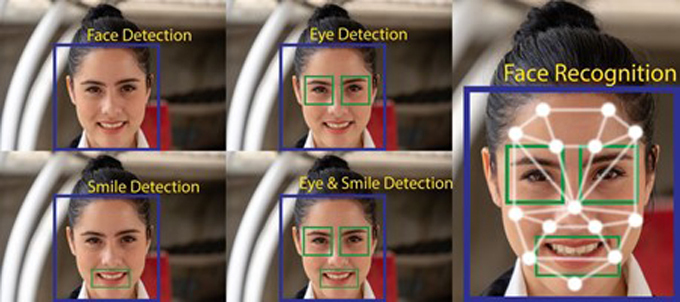

Deepfake đang trở nên phổ biến.

Jared Reeder, một nhân viên tại EY, chia sẻ trên Wired : “Chúng tôi sử dụng công cụ này như một yếu tố tạo nên sự khác biệt và củng cố bản sắc của một người”.

Quá trình tạo ra một bản sao bằng deepfake tương đối đơn giản. Người dùng ngồi trước máy quay khoảng 40 phút, đọc một kịch bản chuẩn bị sẵn. Cảnh quay và âm thanh sẽ dạy thuật toán của Synthesia về các chuyển động trên khuôn mặt và cách phát âm của người đó để bắt chước ngoại hình và giọng nói.

Sau đó, người dùng chỉ việc nhập những gì họ muốn nói và bản sao sẽ thực hiện bài thuyết trình thay họ.

Ranh giới giữa tiện ích và nguy cơ

Ngay khi deepfake lần đầu xuất hiện năm 2017, công nghệ này đã thu hút sự chú ý trên mạng xã hội. Deepfake về cơ bản là việc sử dụng công cụ AI để gán khuôn mặt hay giọng nói của người này sang người khác trong ảnh, video… với độ chân thực đến kinh ngạc.

Theo thống kê, deepfake được sử dụng nhiều nhất trong việc tạo ra video khiêu dâm với khuôn mặt của người nổi tiếng. Việc ghép và chỉnh sửa khuôn mặt như vậy có thể gây ra mối đe dọa tiềm tàng đối với danh tiếng của các cá nhân và tăng khả năng lan truyền thông tin sai lệch.

Bất chấp khả năng bị lạm dụng, nhiều lĩnh vực đang nắm bắt và ứng dụng deepfake, như trong trường hợp của EY, vào những mục đích tích cực hơn. Ngành công nghiệp quảng cáo cũng đang đi theo con đường này, như Spotify, Hulu và nhiều tổ chức chọn sử dụng deepfake cho các chiến dịch truyền thông của họ.

Hạ viện Hà Lan bị đánh lừa bởi deepfake

Ủy ban đối ngoại Hạ viện Hà Lan bị lừa họp trực tuyến với một người dùng deepfake đóng giả cố vấn của lãnh đạo đối lập Nga, Navalny.

Các hạ nghị sĩ Hà Lan nhận được bài học về mối nguy hiểm của video deepfake khi Ủy ban đối ngoại tổ chức cuộc họp trực tuyến với một người đóng giả Leonid Volkov, cố vấn thân cận của lãnh đạo đối lập Nga Alexei Navalny.

Volkov thật (trái) và Volkov giả trong cuộc họp.

Thủ phạm chưa được công bố, nhưng đây không phải lần đầu sự việc này diễn ra. Nghi phạm từng đối thoại với các chính trị gia Latvia và Ukraine, cũng như tiếp cận nhiều quan chức Estonia, Litva và Anh bằng cách tương tự.

Hạ viện Hà Lan ra thông cáo bày tỏ "phẫn nộ" với vụ lừa đảo và cho biết đang tìm cách ngăn chặn những sự việc tương tự tái diễn.

Dường như cuộc gọi không gây tổn hại nào cho cơ quan lập pháp Hà Lan, nhưng nó cho thấy mối đe dọa của những cuộc gọi dùng deepfake với giới chính trị gia. Các cá nhân thích đùa có thể chỉ làm họ mất mặt, trong khi kẻ xấu đủ sức lừa chính quyền đưa ra những chính sách sai lầm. Điều này đòi hỏi quy trình giám sát nghiêm ngặt để phát hiện deepfake vào bảo đảm những người tham gia họp trực tuyến đều là thật.

Hacker Trung Quốc trốn thuế bằng deepfake  Với một chiếc smartphone và công nghệ deepfake, hai hacker Trung Quốc đã đánh lừa hệ thống nhận diện khuôn mặt của chính phủ để gian lận 76,2 triệu USD tiền thuế. Daily Telegraph dẫn thông báo của Viện kiểm soát Nhân dân Thượng Hải cho biết, một nhóm tội phạm đã đánh lừa hệ thống xác minh danh tính của Cơ quan...

Với một chiếc smartphone và công nghệ deepfake, hai hacker Trung Quốc đã đánh lừa hệ thống nhận diện khuôn mặt của chính phủ để gian lận 76,2 triệu USD tiền thuế. Daily Telegraph dẫn thông báo của Viện kiểm soát Nhân dân Thượng Hải cho biết, một nhóm tội phạm đã đánh lừa hệ thống xác minh danh tính của Cơ quan...

Độc lạ 'vua hài' Xuân Hinh rap, Hòa Minzy 'gây bão' triệu view04:19

Độc lạ 'vua hài' Xuân Hinh rap, Hòa Minzy 'gây bão' triệu view04:19 Vụ ngoại tình hot nhất MXH hôm nay: Bỏ 400 triệu đồng giúp chồng làm ăn, vợ mở camera phát hiện sự thật đau lòng00:57

Vụ ngoại tình hot nhất MXH hôm nay: Bỏ 400 triệu đồng giúp chồng làm ăn, vợ mở camera phát hiện sự thật đau lòng00:57 Video sốc: Chụp ảnh check in, thanh niên 20 tuổi bất ngờ bị sóng "nuốt gọn" ngay trước mắt bạn bè00:31

Video sốc: Chụp ảnh check in, thanh niên 20 tuổi bất ngờ bị sóng "nuốt gọn" ngay trước mắt bạn bè00:31 Vì sao Văn Toàn dễ dàng cho Hoà Minzy vay 4 tỷ nhưng lần thứ hai cô bạn thân hỏi vay tiếp thì say "No"?00:44

Vì sao Văn Toàn dễ dàng cho Hoà Minzy vay 4 tỷ nhưng lần thứ hai cô bạn thân hỏi vay tiếp thì say "No"?00:44 Toàn cảnh vụ fan 'Anh trai say hi' mắng nghệ sĩ tới tấp ở rạp chiếu phim02:46

Toàn cảnh vụ fan 'Anh trai say hi' mắng nghệ sĩ tới tấp ở rạp chiếu phim02:46 Về Ninh Thuận gặp ông bà ngoại bé Bắp giữa ồn ào 16,7 tỷ đồng từ thiện: "Con tôi nhỡ miệng, mong cô chú tha thứ cho nó"04:58

Về Ninh Thuận gặp ông bà ngoại bé Bắp giữa ồn ào 16,7 tỷ đồng từ thiện: "Con tôi nhỡ miệng, mong cô chú tha thứ cho nó"04:58 Người đàn ông không rời mắt khỏi Mỹ Tâm01:04

Người đàn ông không rời mắt khỏi Mỹ Tâm01:04Tin đang nóng

Tin mới nhất

Nâng cao và biến đổi hình ảnh của bạn bằng trình chỉnh sửa video trực tuyến CapCut

Cách đăng Facebook để có nhiều lượt thích và chia sẻ

Thêm nhiều bang của Mỹ cấm TikTok

Microsoft cấm khai thác tiền điện tử trên các dịch vụ đám mây để bảo vệ khách hàng

Facebook trấn áp hàng loạt công ty phần mềm gián điệp

Meta đối mặt cáo buộc vi phạm các quy tắc chống độc quyền với mức phạt 11,8 tỷ đô

Không cần thăm dò, Musk nên sớm từ chức CEO Twitter

Đại lý Việt nhập iPhone 14 kiểu 'bia kèm lạc'

Khai trương hệ thống vé điện tử và dịch vụ trải nghiệm thực tế ảo XR tại Quần thể Di tích Cố đô Huế

'Dở khóc dở cười' với tính năng trợ giúp người bị tai nạn ôtô của Apple

Xiaomi sa thải hàng nghìn nhân sự

Apple sẽ bắt đầu sản xuất MacBook tại Việt Nam vào giữa năm 2023

Có thể bạn quan tâm

Oscar gây "sóng gió" mạng xã hội xứ Trung, nhưng sự thật khiến dân tình ngã ngửa!

Sao châu á

23:37:45 03/03/2025

Muốn ly hôn, Cardi B đối mặt với điều kiện 'khó nhằn' từ chồng cũ

Sao âu mỹ

23:26:39 03/03/2025

Lễ ăn hỏi của hot girl Salim và thiếu gia tập đoàn may mặc

Sao việt

23:22:54 03/03/2025

Vì sao Hòa Minzy gây sốt?

Nhạc việt

23:19:28 03/03/2025

Ốc Thanh Vân tái xuất gameshow, tiết lộ chuyện chăm sóc mẹ ruột, mẹ chồng

Tv show

23:16:30 03/03/2025

Bước sang tháng 3, đây là những con giáp sẽ trúng mánh lớn Công danh rực rỡ, tiền bạc ào ào, đổi đời trong chớp mắt!

Trắc nghiệm

23:02:48 03/03/2025

Tại sao phim về nữ vũ công thoát y "Anora" thắng giải Phim hay nhất Oscar?

Hậu trường phim

22:40:24 03/03/2025

Hành tung kẻ đâm cảnh sát cơ động tử vong ở Vũng Tàu

Pháp luật

22:39:18 03/03/2025

Đức chịu áp lực lớn vì đoạn tuyệt với năng lượng giá rẻ của Nga

Thế giới

22:12:42 03/03/2025

Sao nữ hạng A "số nhọ" từ Grammy đến Oscar: Biểu diễn xuất sắc vẫn ra về trắng tay

Nhạc quốc tế

21:58:57 03/03/2025

Samsung gây tranh cãi vì ‘mỉa mai’ Steve Jobs

Samsung gây tranh cãi vì ‘mỉa mai’ Steve Jobs Hàng nghìn suất gà quay được giao bằng drone của Google

Hàng nghìn suất gà quay được giao bằng drone của Google

Microsoft mua lại Peer5 để tăng cường sức mạnh cho Microsoft Teams

Microsoft mua lại Peer5 để tăng cường sức mạnh cho Microsoft Teams Gặp đồng nghiệp mỗi ngày trên văn phòng ảo

Gặp đồng nghiệp mỗi ngày trên văn phòng ảo Cách biến điện thoại thành webcam cho máy tính

Cách biến điện thoại thành webcam cho máy tính Thiết bị livestream đắt hàng vì dịch

Thiết bị livestream đắt hàng vì dịch Facebook có thể phát hiện nguồn gốc deepfake

Facebook có thể phát hiện nguồn gốc deepfake AI của Facebook có thể tái tạo kiểu văn bản dựa vào hình ảnh

AI của Facebook có thể tái tạo kiểu văn bản dựa vào hình ảnh Hòa Minzy nhắn tin Facebook cho "vua hài đất Bắc" Xuân Hinh, ngày hôm sau nhận được điều bất ngờ

Hòa Minzy nhắn tin Facebook cho "vua hài đất Bắc" Xuân Hinh, ngày hôm sau nhận được điều bất ngờ Cuộc hôn nhân ngắn nhất showbiz: Sao nữ bị chồng đánh sảy thai rồi vứt trên đường, ly dị sau 12 ngày cưới

Cuộc hôn nhân ngắn nhất showbiz: Sao nữ bị chồng đánh sảy thai rồi vứt trên đường, ly dị sau 12 ngày cưới

Diễn viên Trúc Anh đã chia tay bạn trai đạo diễn?

Diễn viên Trúc Anh đã chia tay bạn trai đạo diễn?

1 Hoa hậu hàng đầu bị cúm và viêm phổi giống Từ Hy Viên, rơi vào tình trạng nguy hiểm chỉ sau 2 ngày phát bệnh

1 Hoa hậu hàng đầu bị cúm và viêm phổi giống Từ Hy Viên, rơi vào tình trạng nguy hiểm chỉ sau 2 ngày phát bệnh Ghen tuông, chồng dùng kéo đâm người đàn ông lạ mặt trong phòng ngủ

Ghen tuông, chồng dùng kéo đâm người đàn ông lạ mặt trong phòng ngủ Kết quả vụ tranh gia sản Từ Hy Viên: 761 tỷ tiền thừa kế chia đôi, chồng Hàn có cú "lật kèo" gây sốc

Kết quả vụ tranh gia sản Từ Hy Viên: 761 tỷ tiền thừa kế chia đôi, chồng Hàn có cú "lật kèo" gây sốc

Sao Việt "huyền thoại" đóng MV của Hòa Minzy, cõi mạng dậy sóng vì các phân cảnh đắt giá từng chút một

Sao Việt "huyền thoại" đóng MV của Hòa Minzy, cõi mạng dậy sóng vì các phân cảnh đắt giá từng chút một Bắc Bling vừa ra mắt đã nhận gạch đá, Hòa Minzy nói gì?

Bắc Bling vừa ra mắt đã nhận gạch đá, Hòa Minzy nói gì? Thấy có nhiều chim lợn, trường mua vàng mã, mời thầy về cúng!

Thấy có nhiều chim lợn, trường mua vàng mã, mời thầy về cúng!

Vợ cũ Huy Khánh thừa nhận bản thân dại

Vợ cũ Huy Khánh thừa nhận bản thân dại