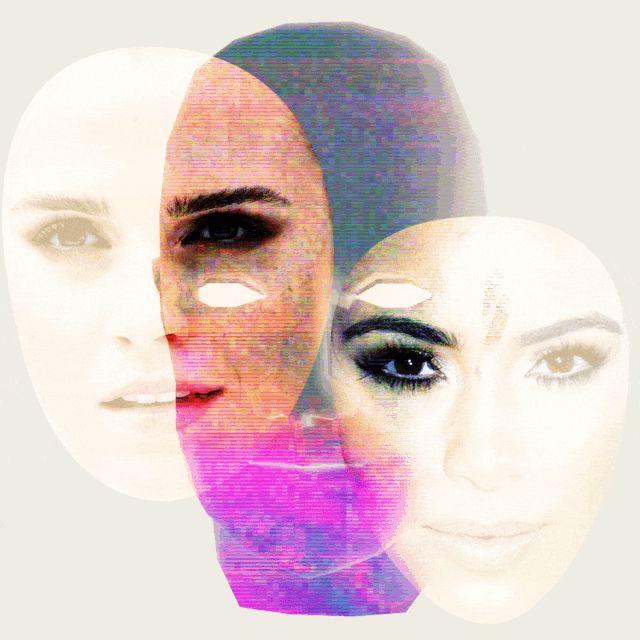

Ngỡ ngàng với video giả khuôn mặt Tom Cruise như thật

Thu hút hơn 11 triệu lượt xem trên Tiktok, các video sử dụng công nghệ deepfake làm giả khuôn mặt tài tử Tom Cruise khiến chúng ta bối rối giữa ranh giới thật và giả.

Video deepfake làm giả từ khuôn mặt cho tới giọng nói, điệu cười của Tom Cruise khiến cộng đồng mạng hoang mang.

“Tôi sẽ cho bạn xem một phép thuật… Đó là món đồ thật,” người với gương mặt của Tom Cruise xuất hiện và nói trước ống kính, trong khi bàn tay nhanh chóng làm ra biến mất đồng xu.

Đây là nội dung của một trong 3 video được đăng tải trên tài khoản Tiktok có tên @deeptomcruise, với đặc điểm chung là trình diễn giọng nói và cử chỉ của người đàn ông mà người xem mặc định coi là tài tử Tom Cruise.

Đến nay, các video đã thu hút hơn 11 triệu lượt xem chỉ sau ít ngày đăng tải, cùng hơn 1 triệu lượt “thả tim”, hơn 35.000 bình luận và chia sẻ.

Đa số người xem các đoạn video ngắn này đều bị đánh lừa bởi công nghệ thay đổi khuôn mặt siêu thực, và ngay cả giọng nói của Tom Cruise.

Thậm chí, “điệu cười điên cuồng” nổi tiếng của nam tài tử Hollywood cũng được bắt chước một cách hoàn hảo.

Các video deepfake tài tử Tom Cruise thu hút sự quan tâm lớn từ cộng đồng Tiktok.

“Đây là một trong những video giả mạo Tom Cruise thực nhất mà tôi từng thấy”, một tài khoản TikTok cho biết.

“Tôi cảm thấy may mắn vì video này chỉ mang tính hài hước, vô hại. Nhưng thật đáng lo ngại nếu nó được dùng cho mục đích xấu”, một tài khoản khác bình luận.

Ngay cả các chuyên gia am hiểu về deepfake cũng gặp khó khăn trong việc nhận diện video này. Giáo sư Hany Farid của Đại học California tại Berkeley (Mỹ) đánh giá các video “được thực hiện cực kỳ tỉ mỉ”, và đây chắc chắn là một trong những đoạn clip deepfake “thực” nhất cho đến nay.

Trong khi đó, Rachel Tobac, Giám đốc điều hành của công ty bảo mật trực tuyến SocialProof bày tỏ sự lo ngại rằng các video deepfake đã đạt tới cấp độ không thể phát hiện được, và ẩn chứa nhiều mối lo ngại.

Trên thực tế rằng trong vài năm trở lại đây thực sự đã khiến vấn đề về hình ảnh, video trên Internet trở nên phức tạp hơn bao giờ hết. Các video ngày càng được làm hoàn chỉnh, rõ nét với độ phân giải cao, khiến người xem hoang mang, lẫn lộn giữa thật và giả.

Hiện vẫn chưa rõ ai đứng sau các video deepfake được đăng tải. Nhưng chúng nhanh chóng được coi là ví dụ về “mặt tối” đáng lo ngại của công nghệ.

"Clip nóng giả mạo đã suýt hủy hoại cuộc đời tôi như thế nào?"

Cách đây hai năm, cô Noelle nhận được email trong đó có những clip "nóng" mà nhân vật chính trong clip... chính là cô. Noelle biết rằng thực sự cô không phải là người ở trong những clip ấy.

"Deepfake" là một công nghệ sử dụng trí tuệ nhân tạo, nó nghiên cứu các chuyển động gương mặt của một người rồi đưa gương mặt của người ấy vào trong một video clip mà người đó thực ra không hề xuất hiện trong đó

Noelle Martin (hiện 25 tuổi) đã tốt nghiệp trường luật và hiện đang sinh sống, làm việc tại Úc. Năm 17 tuổi, cô từng phát hiện ra những bức ảnh của mình đã bị chỉnh sửa thành ảnh khiêu dâm để đăng tải trên một số trang web đen.

Khi ấy, vẫn còn là một nữ sinh trung học, cô đã quyết định lên tiếng bày tỏ quan điểm của mình xung quanh hành động gây tổn hại danh dự, xúc phạm nhân phẩm người khác như thế này. Việc này đã khiến cô Noelle trở thành đối tượng bị nhắm tới của nhiều hành động tấn công online khác trong những năm tháng về sau.

Cách đây hai năm, những clip "nóng" ghép gương mặt của Noelle vào đó bắt đầu xuất hiện như một hành động tấn công online tiếp theo nhắm vào cô.

Dù vậy, Noelle không nản lòng và vẫn tiếp tục những hoạt động của mình trong lĩnh vực luật để chống lại hành vi phát tán những nội dung nhạy cảm khi không nhận được sự cho phép, bất kể đó là nội dung có thật hay nội dung giả mạo.

Hành động của cô gái trẻ đã giúp thúc đẩy những đạo luật được áp dụng tại Úc nhằm góp phần ngăn chặn việc phát tán những hình ảnh và clip nhạy cảm tại Úc. Từ đó, cô Noelle Martin đã trở thành một nhân vật được giới trẻ tại Úc biết đến và ngưỡng mộ. Cô được tôn vinh tại những giải thưởng ghi nhận sự nỗ lực và cống hiến vì cộng đồng.

Dưới đây là bài viết của cô Noelle Martin dành cho tạp chí Elle (Anh) để chia sẻ về trải nghiệm của chính cô khi trên mạng xuất hiện những clip "nóng" giả mạo, trong đó, gương mặt của Noelle bị ghép vào nhân vật nữ trong những clip phát tán trên mạng:

Cô Noelle Martin

Clip "nóng" của những ngôi sao nổi tiếng một khi xuất hiện sẽ bị lan truyền chóng mặt trên mạng, chỉ có điều những clip ấy là giả, dù vậy, chúng cũng có vẻ khá thuyết phục về mặt hình ảnh. Bản thân tôi cũng từng phải xem những clip "nóng" trong đó nhân vật nữ... chính là tôi.

Tôi bàng hoàng nhìn thấy đôi mắt mình trong clip đang nhìn thẳng vào ống kính, những chuyển động trên gương mặt khá tự nhiên, khá thuyết phục, ngay cả với... chính tôi. Tôi nghĩ làm sao những người khác lại không thể bị đánh lừa chứ? Những ai quen biết tôi rất có thể tưởng rằng đó chính là tôi.

Mọi việc bắt đầu từ khi tôi 17-18 tuổi, tôi tình cờ phát hiện ra ảnh trên tài khoản mạng xã hội của mình bị lấy lại, bị chỉnh sửa thành ảnh khiêu dâm và bị đăng tải trên những trang web đen, những bức ảnh được chỉnh sửa rất... thuyết phục, có cả những thông tin cá nhân, có những câu chuyện được thêu dệt nên về tôi, khiến tôi hiểu rằng mình đã trở thành một nhân vật bị theo dõi và bị nhắm đến từ lâu.

Thoạt tiên, tôi sợ hãi tới mức chỉ dám kể cho một vài người bạn thân thiết, sợ hãi rằng một ngày câu chuyện này lộ ra và bố mẹ tôi sẽ cảm thấy ê chề, đau khổ, như những gì mà tôi đã cảm thấy.

Ở thời điểm ấy - năm 2012, vẫn chưa có những điều luật quy định về hành vi xâm hại hình ảnh của người khác trên không gian mạng. Còn giờ đây, công nghệ "deepfake" khiến những hành động tấn công vào một cá nhân có thể còn trở nên khủng khiếp hơn cả việc chế ảnh, bởi những clip "nóng" ghép mặt đã đạt tới mức độ chân thực, có thể đánh lừa người xem.

"Deepfake" là một công nghệ sử dụng trí tuệ nhân tạo, nó nghiên cứu các chuyển động gương mặt của một người rồi đưa gương mặt của người ấy vào trong một video clip mà người đó thực ra không hề xuất hiện trong đó. Những người khác không biết, khi xem qua, có thể cảm thấy hình ảnh khá chân thực và thuyết phục, nên dễ dàng tin ngay.

Kể từ khi công nghệ "deepfake" xuất hiện, bắt đầu có những clip "nóng" lồng ghép gương mặt của người nổi tiếng trôi nổi trên mạng, bởi khi một nhân vật có tần suất xuất hiện nhiều, trí tuệ nhân tạo sẽ có nhiều hình ảnh và clip để "nghiên cứu", tạo nên clip "deepfake" rất thuyết phục.

Cách đây hai năm, cô Noelle nhận được email trong đó có những clip "nóng" mà nhân vật chính trong clip... chính là cô. Noelle biết rằng thực sự cô không phải là người ở trong những clip ấy.

Giờ đây, khi các ứng dụng "deepfake" trở nên dễ tiếp cận, những clip giả mạo càng dễ được thực hiện. Trên không gian mạng, người ta đã quen với việc ý thức rằng một bức ảnh có thể đã bị chỉnh sửa và không phản ánh đúng sự thật, nhưng vẫn chưa nhiều người có ý thức cảnh giác với video clip.

Kể từ lần đầu biết mình bị ghép ảnh và đăng tải lên web đen, tôi đã không ngừng liên hệ với các bên sở hữu những trang web ấy để tìm cách xử lý vấn đề triệt để, yêu cầu họ tháo gỡ nội dung, tôi cũng liên hệ với nhà chức trách, với các chuyên gia về luật để tìm ra các giải pháp hữu hiệu, nhưng những điều này đều không thể diễn ra một cách dễ dàng, thuận lợi.

Chúng ta hiểu rằng các điều luật luôn đi sau thực tế một khoảng thời gian. Kể từ lần đầu biết mình bị chế ảnh hồi năm 17-18 tuổi, cho tới giờ, tôi vẫn tiếp tục trở thành mục tiêu bị nhắm tới của những nội dung xấu, độc, nhưng tôi cũng không ngừng hành động theo cách của mình, với những nỗ lực suốt gần một thập kỷ qua. Không thể nói rằng tôi chưa từng cảm thấy đau đớn...

Dù vậy, tôi hiểu rằng nếu tôi không hành động, điều đó giống như thể tôi âm thầm chấp nhận những nội dung xấu, độc đó. Cho dù tôi không bao giờ có thể tìm cách xóa bỏ hết mọi bức ảnh và video chế kia, thì ít nhất tôi đã có thể làm rõ ràng vấn đề và tự mình đưa lại sự trong sạch cho tên tuổi và hình ảnh của chính mình.

Giờ đây, tôi đang làm việc trong lĩnh vực luật, tôi đã đạt được những kết quả nhất định trong hành trình chống lại việc chế ảnh của người khác để trở thành những nội dung gây xúc phạm danh dự, nhân phẩm của một người. Ít nhất, giờ đây, hành vi này đã chính thức bị xem là hành vi vi phạm pháp luật tại Úc.

Đối với tôi bây giờ, hàn gắn bản thân chính là không cho phép những nội dung ấy được quyền tác động tới mình theo những cách tiêu cực. Tôi đã mất gần một thập kỷ để đạt được điều đó, giờ đây, tôi đã nhìn nhận mọi chuyện nhẹ nhàng, tích cực hơn.

Thông tin búp bê Annabelle biến mất khỏi bảo tàng là giả  Dân mạng được một phen hoảng loạn trước tin đồn búp bê ma khét tiếng rời khỏi bảo tàng Warren. Ngày 14/8, mạng xã hội trở được một phen hoảng loạn khi hay tin búp bê ma Annabelle, một nhân vật có thật trong loạt vụ án kỳ bí, đã "trốn thoát" khỏi bảo tàng Warren. Chưa đầy 12 tiếng, Annabelle nhanh chóng...

Dân mạng được một phen hoảng loạn trước tin đồn búp bê ma khét tiếng rời khỏi bảo tàng Warren. Ngày 14/8, mạng xã hội trở được một phen hoảng loạn khi hay tin búp bê ma Annabelle, một nhân vật có thật trong loạt vụ án kỳ bí, đã "trốn thoát" khỏi bảo tàng Warren. Chưa đầy 12 tiếng, Annabelle nhanh chóng...

Clip: Xe bán tải bị đâm nát trên đường tại Sơn La, bé gái trong xe không ngừng hoảng loạn kêu cứu "bố ơi"00:55

Clip: Xe bán tải bị đâm nát trên đường tại Sơn La, bé gái trong xe không ngừng hoảng loạn kêu cứu "bố ơi"00:55 Đoạn camera đau lòng đang được chia sẻ trên MXH: Người phụ nữ bị chồng đánh dã man, các con ôm mẹ gào khóc00:52

Đoạn camera đau lòng đang được chia sẻ trên MXH: Người phụ nữ bị chồng đánh dã man, các con ôm mẹ gào khóc00:52 Phát ngôn về chuyện sao kê của mẹ bé Bắp làm dậy sóng MXH giữa lúc tắt tính năng bình luận01:09

Phát ngôn về chuyện sao kê của mẹ bé Bắp làm dậy sóng MXH giữa lúc tắt tính năng bình luận01:09 Vụ ngoại tình hot nhất MXH hôm nay: Bỏ 400 triệu đồng giúp chồng làm ăn, vợ mở camera phát hiện sự thật đau lòng00:57

Vụ ngoại tình hot nhất MXH hôm nay: Bỏ 400 triệu đồng giúp chồng làm ăn, vợ mở camera phát hiện sự thật đau lòng00:57 Video sốc: Chụp ảnh check in, thanh niên 20 tuổi bất ngờ bị sóng "nuốt gọn" ngay trước mắt bạn bè00:31

Video sốc: Chụp ảnh check in, thanh niên 20 tuổi bất ngờ bị sóng "nuốt gọn" ngay trước mắt bạn bè00:31Tiêu điểm

Tin đang nóng

Tin mới nhất

Cảnh tượng thót tim trên chuyến bay đến Bangkok: Khói dày đặc bao phủ khiến hàng trăm hành khách hoảng loạn

Clip cô gái dạy chồng Tây đếm số tiếng Việt hài hước hút hơn 2 triệu lượt xem

Shipper đỏ mặt nghe thấy âm thanh nhạy cảm khi gọi điện giao trà sữa, sau 3 cuộc gọi anh chàng tuyên bố: Đem đi biếu cô đồng nát!

Xả ảnh nét căng lễ ăn hỏi của Salim và Hải Long, 2 bó hoa cầm tay bỗng khiến netizen đổ xô xin "in tư"

Xôn xao cảnh hơn 200 người đổ xô đến 1 căn nhà ở Hải Phòng, biết lý do tất cả nổ ra tranh cãi lớn

Chủ quán trà sữa cốm lên tiếng sau clip liếm cốc khi đóng hàng cho khách

Bức ảnh người cha kèm con học gây bão mạng: Lý do nằm ở thứ đứa trẻ mang trên đầu

Khoảnh khắc em bé Nhật Bản nghị lực không chịu bỏ cuộc khiến hàng triệu người xúc động

Bị cha mắng vì nói sai OTP, cô gái 19 tuổi tự tử

Đi ngược về quá khứ ghen tuông với chồng và bạn học lớp mẫu giáo khiến tất cả thốt lên: Chị thắng!

Căn phòng KTX khiến netizen nổi da gà nhất lúc này: Lối đi nhỏ bằng 1 cái laptop, nhìn nhà vệ sinh còn "rùng mình" hơn

"Đột nhập" canteen trường quốc tế sở hữu kiến trúc đẹp mê: Đồ Âu - đồ Á có đủ, nhìn suất ăn đầy đặn mà ai cũng cồn cào

Có thể bạn quan tâm

Quần thể di tích Núi Cậu: Sự kết hợp giữa thiên nhiên, lịch sử và tâm linh

Du lịch

08:43:36 04/03/2025

Nhiễm nấm đường ruột nguy hiểm như nào?

Sức khỏe

08:39:25 04/03/2025

Rời Mỹ sau cuộc gặp thảm họa, ông Zelensky được chào đón nồng nhiệt tại Anh

Thế giới

08:38:42 04/03/2025

Á quân Vietnam Idol: Nợ 500 triệu, bật khóc nhớ giai đoạn khắc nghiệt

Sao việt

08:31:17 04/03/2025

Lần đầu trái đất và 7 hành tinh xuất hiện trong cùng một hình ảnh

Lạ vui

08:00:59 04/03/2025

Nữ chính phim 18+ giành chiến thắng gây 'choáng' ở Oscar 2025 là ai?

Sao âu mỹ

07:46:27 04/03/2025

Chế Thanh: Gác cải lương chuyển sang nhạc trẻ, tôi đổi đời chỉ với một ca khúc

Tv show

07:41:26 04/03/2025

Cha tôi, người ở lại - Tập 7: Mẹ cố tình xát muối vào vết thương lòng của con trai

Phim việt

07:33:07 04/03/2025

ĐTCL mùa 13: 3 đội hình sắp "hóa rồng" ở meta mới nhờ Riot "hồi sinh" mạnh mẽ

Mọt game

07:33:01 04/03/2025

Chuyện gì đang xảy ra với Thanh Sơn?

Hậu trường phim

07:26:10 04/03/2025

Hot boy từng “nổi như cồn” vì góc nghiêng giống Sơn Tùng M-TP giờ ra sao?

Hot boy từng “nổi như cồn” vì góc nghiêng giống Sơn Tùng M-TP giờ ra sao? Lo ngại trước những clip “tưởng không thật mà… thật không tưởng”

Lo ngại trước những clip “tưởng không thật mà… thật không tưởng”

Thấy có nhiều chim lợn, trường mua vàng mã, mời thầy về cúng!

Thấy có nhiều chim lợn, trường mua vàng mã, mời thầy về cúng! Cận cảnh đám cưới làm tắc nghẽn phố Hàng Đào 45 năm trước, chuyện tình của cặp đôi nổi tiếng như "xé truyện" bước ra

Cận cảnh đám cưới làm tắc nghẽn phố Hàng Đào 45 năm trước, chuyện tình của cặp đôi nổi tiếng như "xé truyện" bước ra

Mẹ bé Bắp gây sốc với ngoại hình hiện tại, nói về tình trạng của mình sau 1 tuần sóng gió

Mẹ bé Bắp gây sốc với ngoại hình hiện tại, nói về tình trạng của mình sau 1 tuần sóng gió Một trường THPT phải giải trình việc thuê thầy về cúng bái giữa sân

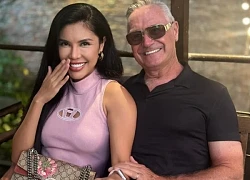

Một trường THPT phải giải trình việc thuê thầy về cúng bái giữa sân Mẹ đơn thân lấy chồng Tây hơn 29 tuổi, phản ứng cực khéo khi con trai kể bạn hỏi "sao bố cậu già vậy?"

Mẹ đơn thân lấy chồng Tây hơn 29 tuổi, phản ứng cực khéo khi con trai kể bạn hỏi "sao bố cậu già vậy?"

Thái độ Xuân Hinh dành cho Hòa Minzy

Thái độ Xuân Hinh dành cho Hòa Minzy Tờ hóa đơn trong túi áo hé lộ bí mật động trời của chồng, cay đắng hơn cả, anh chỉ nói đúng 3 từ khi bị vạch trần

Tờ hóa đơn trong túi áo hé lộ bí mật động trời của chồng, cay đắng hơn cả, anh chỉ nói đúng 3 từ khi bị vạch trần Mẹ tôi nhập viện sau khi phát hiện con dâu mua món đồ lạ xa xỉ đặt chình ình giữa nhà

Mẹ tôi nhập viện sau khi phát hiện con dâu mua món đồ lạ xa xỉ đặt chình ình giữa nhà Sau khi phát hiện "vết muỗi đốt" trên cổ chồng, tôi không ngờ lại phải ly hôn vì lý do... chồng thất tình

Sau khi phát hiện "vết muỗi đốt" trên cổ chồng, tôi không ngờ lại phải ly hôn vì lý do... chồng thất tình Nửa đêm nghe tiếng khóc bên phòng con rể, tôi hốt hoảng đẩy cửa vào thì thấy con gái đang quỳ trên nền nhà cầu xin chồng giải thoát

Nửa đêm nghe tiếng khóc bên phòng con rể, tôi hốt hoảng đẩy cửa vào thì thấy con gái đang quỳ trên nền nhà cầu xin chồng giải thoát Nữ ca sĩ trẻ nhất được phong NSND: Giàu có, ở biệt phủ 8000m2, lấy chồng 3 sau 2 lần đổ vỡ

Nữ ca sĩ trẻ nhất được phong NSND: Giàu có, ở biệt phủ 8000m2, lấy chồng 3 sau 2 lần đổ vỡ Bé gái 7 tuổi mất tích giữa đêm, cả làng ra quyết định khẩn cấp

Bé gái 7 tuổi mất tích giữa đêm, cả làng ra quyết định khẩn cấp

Kết quả vụ tranh gia sản Từ Hy Viên: 761 tỷ tiền thừa kế chia đôi, chồng Hàn có cú "lật kèo" gây sốc

Kết quả vụ tranh gia sản Từ Hy Viên: 761 tỷ tiền thừa kế chia đôi, chồng Hàn có cú "lật kèo" gây sốc Sao Việt "huyền thoại" đóng MV của Hòa Minzy, cõi mạng dậy sóng vì các phân cảnh đắt giá từng chút một

Sao Việt "huyền thoại" đóng MV của Hòa Minzy, cõi mạng dậy sóng vì các phân cảnh đắt giá từng chút một Hòa Minzy nhắn tin Facebook cho "vua hài đất Bắc" Xuân Hinh, ngày hôm sau nhận được điều bất ngờ

Hòa Minzy nhắn tin Facebook cho "vua hài đất Bắc" Xuân Hinh, ngày hôm sau nhận được điều bất ngờ Bắc Bling vừa ra mắt đã nhận gạch đá, Hòa Minzy nói gì?

Bắc Bling vừa ra mắt đã nhận gạch đá, Hòa Minzy nói gì? Cuộc hôn nhân ngắn nhất showbiz: Sao nữ bị chồng đánh sảy thai rồi vứt trên đường, ly dị sau 12 ngày cưới

Cuộc hôn nhân ngắn nhất showbiz: Sao nữ bị chồng đánh sảy thai rồi vứt trên đường, ly dị sau 12 ngày cưới

Bố mẹ vợ Quang Hải mang đặc sản thiết đãi thông gia, một mình Chu Thanh Huyền ngồi đất ăn món bình dân gây sốt

Bố mẹ vợ Quang Hải mang đặc sản thiết đãi thông gia, một mình Chu Thanh Huyền ngồi đất ăn món bình dân gây sốt