4.000 người nổi tiếng trên thế giới “xuất hiện” trong nội dung khiêu dâm

Đài Channel 4 (Anh) vừa đưa ra một thống kê gây sốc. Theo đó, có gần 4.000 người nổi tiếng trên thế giới là nạn nhân của những nội dung khiêu dâm sử dụng công nghệ “ deepfake”.

Trong số gần 4.000 người nổi tiếng trở thành nạn nhân của công nghệ “deepfake” có hơn 250 người là các nhân vật nổi tiếng tại Anh. Ê-kíp phóng viên của đài Channel 4 đã phân tích nội dung trên 5 website chuyên cung cấp nội dung “deepfake” có lượt người xem lớn nhất.

Thống kê cũng cho thấy có nhiều diễn viên, ca sĩ, ngôi sao mạng xã hội ở nhiều quốc gia đã trở thành nạn nhân của công nghệ “deepfake”. Gương mặt của họ bị lồng ghép vào những nội dung khiêu dâm sử dụng công nghệ do trí tuệ nhân tạo thực hiện.

Nữ ca sĩ người Mỹ Taylor Swift là một trong những nạn nhân của những clip “deepfake” độc hại (Ảnh: Page Six).

Điều tra của đài Channel 4 cũng cho thấy rằng 5 website mà họ phân tích đã nhận được 100 triệu lượt xem chỉ trong vòng 3 tháng.

Kể từ ngày 31/1, đạo luật An toàn trên không gian mạng đã được áp dụng tại Anh. Việc chia sẻ các nội dung sử dụng công nghệ “deepfake” mà không có sự đồng ý của nhân vật xuất hiện trong nội dung bị xem là hành vi bất hợp pháp. Dù vậy, hành vi tạo ra nội dung sử dụng công nghệ “deepfake” vẫn chưa bị xem là hành vi phạm luật tại Anh.

Vấn nạn nội dung khiêu dâm sử dụng công nghệ “deepfake” đang trở nên đáng báo động ở nhiều quốc gia. Theo thông tin mà đài Channel 4 đưa ra, chỉ trong 3 quý của năm 2023 đã có tới gần 145.000 video khiêu dâm sử dụng công nghệ “deepfake” được đăng tải lên 40 website “đen”. Con số này bằng tổng lượng nội dung “deepfake” được thực hiện trong vòng vài năm trước đó cộng lại.

Hồi đầu năm nay, hình ảnh khiêu dâm lồng ghép gương mặt của nữ ca sĩ Taylor Swift lan truyền trên mạng xã hội Mỹ khiến cộng đồng fan của cô rất tức giận.

Sự việc xảy tới với Taylor Swift khiến dư luận Mỹ đặt ra câu hỏi: Tại sao vẫn chưa có những quy định cụ thể trong luật pháp Mỹ xung quanh hành vi tạo ra nội dung khiêu dâm, có lồng ghép gương mặt của người thật, rồi đem phát tán trên không gian mạng?

Sự việc này tiếp tục khiến các nhà làm luật tại Mỹ cân nhắc tới việc đưa hành vi phát tán nội dung khiêu dâm làm ảnh hưởng tới danh dự người khác ra trước pháp luật.

Những nhân vật nổi tiếng có nhiều ảnh và clip tồn tại trên mạng là nhân vật dễ bị nhắm đến (Ảnh: Page Six).

Video đang HOT

Thực tế, trong thời đại hiện nay, hình ảnh và danh dự của một cá nhân có thể bị tác động mạnh bởi những nội dung do trí tuệ nhân tạo thực hiện. Những ảnh hưởng này có thể tác động nghiêm trọng tới công việc và cuộc sống, sức khỏe và tinh thần của một cá nhân.

Thực tế, từ năm 2011, Taylor Swift đã đưa ra cảnh báo tới các fan về những hình ảnh ngực trần và các nội dung khiêu dâm khác có lồng ghép gương mặt của cô. Swift chưa thể thực hiện các động thái pháp lý chính thức và chỉ có thể phát đi cảnh báo tới cộng đồng fan.

Hiện tượng các clip “deepfake” đang ngày càng trở nên chân thực đến mức dễ dàng đánh lừa người xem khiến nhiều chuyên gia công nghệ lo lắng.

Ông Sam Gregory – giám đốc điều hành của một tổ chức bảo vệ nhân quyền tại Anh – chia sẻ: “Nhiều phụ nữ đã trở thành nạn nhân của những clip “deepfake” độc hại. Giờ đây, trong không gian mạng, người dùng Internet tỉnh táo phải hiểu rằng ngay cả mắt nhìn thấy cũng chưa thể tin ngay được. Điều này rất đáng ngại, bởi clip thật có thể bị nghi ngờ là giả, và clip giả có thể bị tưởng lầm là thật”.

“Deepfake” là một thuật ngữ ghép từ hai từ trong tiếng Anh gồm “deep learning” (học sâu) và “fake” (giả mạo) để nói về việc trí tuệ nhân tạo nghiên cứu, tìm hiểu sâu kỹ về biểu cảm gương mặt của một người, rồi tạo nên được những hình ảnh giả mạo đặc tả gương mặt người đó để lồng ghép vào trong clip mà người đó thực ra không hề xuất hiện.

Hình ảnh tạo ra lại khá chân thực, có thể khiến người xem thoạt tiên tưởng đó là nội dung có thực. Càng ngày, các ứng dụng “deepfake” càng trở nên phát triển và đưa lại những hình ảnh chân thực hơn.

Từ năm 2011, Taylor Swift đã đưa ra cảnh báo tới các fan về những hình ảnh khiêu dâm có lồng ghép gương mặt của cô (Ảnh: Page Six).

Những nhân vật nổi tiếng có nhiều ảnh và clip tồn tại trên mạng là nhân vật dễ bị nhắm đến, bởi trí tuệ nhân tạo sẽ có sẵn nhiều thông tin dữ liệu về các góc mặt, thói quen biểu cảm, cách mở khẩu hình miệng…

Chuyên gia trong lĩnh vực công nghệ tại Anh – ông Henry Ajder – chia sẻ: “Công nghệ này sẽ tồn tại kể từ đây trong cuộc sống của chúng ta, và chúng ta sẽ chuẩn bị phải đón nhận những sự vụ mà trong đó, những nội dung tiêu cực, độc hại được tạo ra bằng chính công cụ này”.

Bà Rachel Tobac – CEO của một công ty chuyên cung cấp dịch vụ an ninh mạng tại Anh – cho biết: “Giờ đây, đã có những video clip “deepfake” thật đến mức gần như khó tìm ra manh mối để biết đó là clip giả mạo.

Clip “deepfake” sẽ ảnh hưởng tới niềm tin của công chúng, khiến những kẻ phạm tội bị ghi hình lại bằng video clip thoạt tiên có thể chối cãi rằng đó là clip giả. Ngược lại, những người không gây ra hành vi xấu lại có thể bị nhắm đến, bị bêu riếu và bị làm tổn thương bằng các clip giả mạo”.

Hình ảnh khêu gợi giả mạo Taylor Swift lan truyền trên mạng xã hội

Việc các bức ảnh khêu gợi giả mạo của siêu sao Taylor Swift bị phát tán trong tuần này chứng tỏ trí tuệ nhân tạo (AI) đã tạo ra những hình ảnh rõ nét, gây tổn hại đến người khác.

Với sự gia tăng khả năng tiếp cận các công cụ AI, nhiều chuyên gia cho rằng mọi chuyện sắp trở nên tồi tệ hơn rất nhiều, không chỉ với người nổi tiếng như Taylor Swift mà còn cả mọi người từ trẻ em trong độ tuổi đi học đến người lớn.

Hiện tại, một số học sinh trung học trên khắp thế giới đã báo cáo rằng khuôn mặt của họ đã bị AI thao túng và được các bạn cùng lớp chia sẻ lên mạng. Một nữ streamer trẻ tuổi nổi tiếng phát hiện ra chân dung của cô ấy đang được sử dụng trong một video khiêu dâm giả mạo, rõ ràng và lan truyền nhanh chóng khắp cộng đồng game.

Danielle Citron, giáo sư tại trường Đại học Luật Virginia (Mỹ), nói với CNN: "Không chỉ những người nổi tiếng được nhắm đến mà còn có y tá, sinh viên nghệ thuật và luật, giáo viên, nhà báo... Điều này tác động mạnh đến học sinh trung học và những người trong quân đội. Nó ảnh hưởng đến tất cả mọi người".

Taylor Swift là nạn nhân mới nhất của chuyện tung ảnh khêu gợi giả mạo lên mạng xã hội. REUTERS

Taylor Swift trở thành mục tiêu giả mạo đã thu hút nhiều sự chú ý hơn đến việc ngày càng gia tăng hình ảnh do AI tạo ra. Tuần này, đội ngũ "Swifties" (fan trung thành của nữ ca sĩ) đã bày tỏ sự phẫn nộ trên mạng xã hội.

Vào năm 2022, cuộc khủng hoảng của công ty bán vé Ticketmaster trước buổi hòa nhạc Eras Tour của Taylor Swift làm dấy lên cơn thịnh nộ trên mạng, dẫn đến một số nỗ lực lập pháp nhằm trấn áp các chính sách bán vé không thân thiện với người tiêu dùng.

Những hình ảnh giả mạo của Taylor Swift chủ yếu lan truyền trên trang mạng xã hội X - trước đây gọi là Twitter - cho thấy nữ ca sĩ đang trong tư thế khiêu dâm và được xem hàng chục triệu lần trước khi bị xóa. Nhưng không có gì trên internet thực sự biến mất mãi mãi và chắc chắn chúng sẽ tiếp tục được chia sẻ trên các kênh khác ít được quản lý hơn.

Mặc dù đã có những cảnh báo rõ ràng về việc hình ảnh và video do AI tạo ra có thể gây hiểu lầm khi được sử dụng để làm chệch hướng cuộc bầu cử tổng thống Mỹ và thúc đẩy chuyện đưa thông tin sai lệch nhưng vẫn có ít cuộc thảo luận công khai hơn về việc khuôn mặt của phụ nữ bị thao túng, mà không có sự đồng ý của họ, thậm chí biến thành các video khiêu dâm mang tính công kích.

Xu hướng ngày càng tăng là AI tương đương với một hoạt động được gọi là "trả thù". Và ngày càng khó để xác định xem ảnh và video có xác thực hay không.

Tuy nhiên, điều khác biệt lần này là lượng người hâm mộ trung thành của Taylor Swift đã tập hợp lại tạo áp lực nhằm gỡ các bài đăng xuống một cách hiệu quả. Cô Citron nhận định: "Rất nhiều người tham gia vào nỗ lực đó vì nạn nhân là Taylor Swift trong khi hầu hết người không nổi tiếng khác phải đối diện với chính mình".

Mặc dù được cho là phải mất 17 giờ để ban quản trị X gỡ các bức ảnh xuống nhưng nhiều hình ảnh bị chỉnh sửa vẫn được đăng trên các trang mạng xã hội khác. Theo Ben Decker, người điều hành Memetica, một cơ quan điều tra kỹ thuật số, các công ty truyền thông xã hội "không thực sự có kế hoạch hiệu quả để giám sát nội dung".

Giống như hầu hết các nền tảng truyền thông xã hội lớn, chính sách của X cấm chia sẻ "hình ảnh, video bị thao túng hoặc có thể đánh lừa, gây nhầm lẫn cho mọi người dẫn đến tổn hại". Nhưng đồng thời, X đã loại bỏ phần lớn nhóm kiểm duyệt nội dung của mình và dựa vào hệ thống tự động để báo cáo người dùng. Tại châu Âu, X hiện đang bị điều tra về các hoạt động kiểm duyệt nội dung. Công ty không trả lời yêu cầu bình luận của CNN.

Nhiều công ty truyền thông xã hội khác cũng đã giảm bớt đội ngũ kiểm duyệt nội dung của họ. Ví dụ, Meta đã cắt giảm các nhóm giải quyết thông tin sai lệch cũng như điều phối các chiến dịch troll và quấy rối trên nền tảng của mình. Những người có hiểu biết trực tiếp về tình hình nói với CNN, điều này làm dấy lên lo ngại trước cuộc bầu cử quan trọng năm 2024 ở Mỹ và trên toàn thế giới.

Đa số nạn nhân bị phát tán ảnh, video khiêu dâm giả mạo trên mạng xã hội là nữ. CNN

Decker cho biết những gì đã xảy ra với Taylor Swift là một "ví dụ điển hình về cách AI được tung ra vì nhiều lý do bất chính mà không có đủ rào chắn để bảo vệ".

Xu hướng ngày càng tăng

Mặc dù công nghệ AI đã có từ lâu nhưng hiện tại nó đang nhận được sự chú ý mới vì những bức ảnh phản cảm của Taylor Swift.

Năm ngoái, một học sinh trung học ở New Jersey (Mỹ) từng phát động một chiến dịch xây dựng luật liên bang để giải quyết các hình ảnh khiêu dâm do AI tạo ra sau khi xác nhận những bức ảnh của cô và 30 bạn nữ khác cùng lớp đã bị chỉnh sửa và chia sẻ trên mạng.

Francesca Mani, một học sinh tại trường trung học Westfield, bày tỏ sự thất vọng trước việc thiếu cơ sở pháp lý để bảo vệ nạn nhân bị đưa ảnh mang nội dung khiêu dâm do AI tạo ra. Mẹ cô nói với CNN rằng có vẻ như "một cậu bé hoặc một số cậu bé" đã tạo ra những hình ảnh này mà không có sự đồng ý của các cô gái.

Việc giải quyết vấn đề này vẫn còn khó khăn. 9 tiểu bang ở Mỹ hiện có luật chống lại việc tạo hoặc chia sẻ ảnh, video giả mạo mà không có sự đồng thuận nhưng không có luật nào tồn tại ở cấp liên bang.

Cô Citron nói thêm: "Không thể trừng phạt hành vi đó theo luật khiêu dâm trẻ em... vì không có hành vi lạm dụng tình dục trẻ em nào xảy ra. Nhưng cảm giác bị sỉ nhục và cảm giác bị biến thành một đồ vật, bị người khác coi bạn như một đồ vật tình dục và cách bạn tiếp thu cảm giác đó... thực sự gây tổn hại khủng khiếp đến lòng tự trọng xã hội của bạn".

Cách bảo vệ hình ảnh

Chuyên gia bảo mật máy tính David Jones khuyên mọi người nên giữ hồ sơ video, ảnh ở chế độ riêng tư và chỉ chia sẻ video, ảnh với những người đáng tin cậy vì "bạn không bao giờ biết ai có thể xem hồ sơ của mình".

David Jones cảnh báo rằng do AI đang trở nên hiệu quả hơn nên trong tương lai có thể chỉ cần một bức ảnh để tạo ra phiên bản deepfake của một người khác. Tin tặc cũng có thể tìm cách truy cập vào file ảnh. Ông nói: "Nếu tin tặc quyết tâm, chúng có thể phá mật khẩu của bạn để truy cập vào ảnh và video mà bạn chia sẻ trên tài khoản của mình".

Ngày 26.1, Nhà Trắng thông báo đã biết rõ những hình ảnh giả mạo liên quan nữ ca sĩ nhạc pop Taylor Swift và cho rằng các công ty truyền thông xã hội có vai trò quan trọng trong việc thực thi quy tắc riêng của họ nhằm ngăn chặn sự lan truyền những thông tin sai lệch như vậy. Theo Reuters, Thư ký báo chí Nhà Trắng Karine Jean-Pierre xác nhận trong cuộc họp báo: "Điều này rất đáng báo động. Vì vậy, chúng tôi sẽ làm những gì có thể để giải quyết vấn đề này".

Sabrina Carpenter nhảy nhót lố lăng, khán giả phẫn nộ mất hình tượng ca sĩ03:24

Sabrina Carpenter nhảy nhót lố lăng, khán giả phẫn nộ mất hình tượng ca sĩ03:24 Cựu MU 2023 được trao quà đặc biệt, giá trị khủng khiến fan trầm trồ03:25

Cựu MU 2023 được trao quà đặc biệt, giá trị khủng khiến fan trầm trồ03:25 Đạo diễn 47 tuổi bị bắt vì dùng gần 300 tỷ tiền làm phim để tiêu xài cá nhân02:31

Đạo diễn 47 tuổi bị bắt vì dùng gần 300 tỷ tiền làm phim để tiêu xài cá nhân02:31 Đường cong quyến rũ của nữ diễn viên sinh năm 1999 đổi đời nhờ vai ngập cảnh nóng02:37

Đường cong quyến rũ của nữ diễn viên sinh năm 1999 đổi đời nhờ vai ngập cảnh nóng02:37 Đương kim MU: Mới "làm con" Nawat đã bị phốt phông bạt, bay luôn vị trí Big1?03:14

Đương kim MU: Mới "làm con" Nawat đã bị phốt phông bạt, bay luôn vị trí Big1?03:14Tiêu điểm

Tin đang nóng

Tin mới nhất

Thực hư tin đồn Jennifer Aniston hẹn hò tài tử Pedro Pascal

Vợ cũ Arnold Schwarzenegger kể về cuộc hôn nhân bị phản bội

Siêu mẫu Vittoria Ceretti hé lộ mối quan hệ tình cảm với Leonardo DiCaprio

Đường cong quyến rũ của nữ diễn viên sinh năm 1999 đổi đời nhờ vai ngập cảnh nóng

Bi kịch của dàn "sao nhí" hàng đầu: Khi làng giải trí "nghiền nát" cả cuộc đời

Justin Bieber ghét bản thân mình khi không thành thật

Justin Bieber ra sao sau nghi vấn dùng ma túy, bất ổn tinh thần?

Tài tử Alec Baldwin nhiều lần bị vợ mắng trước công chúng

Bí mật mối quan hệ của Leonardo DiCaprio và bạn gái 27 tuổi

Vụ cướp chấn động tại Paris của Kim Kardashian chuẩn bị xét xử

Cuộc sống viên mãn của 'nữ thần' Gal Gadot ở tuổi 40

Đạo diễn 47 tuổi bị bắt vì dùng gần 300 tỷ tiền làm phim để tiêu xài cá nhân

Có thể bạn quan tâm

Khi cuộc đời cho bạn quả quýt gây tranh cãi: Phản ánh bất công hay là ngụy biện?

Phim châu á

11:46:16 28/03/2025

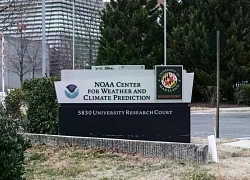

Cơ quan Thời tiết Quốc gia Mỹ sáp nhập khi đối mặt với vấn đề về nhân sự

Thế giới

11:43:57 28/03/2025

Cảnh báo: 9 món đồ này là "sát thủ vô hình" trong nhà, tiềm ẩn nguy cơ gây ung thư

Sáng tạo

11:40:51 28/03/2025

"Em bé thiên niên kỷ" của Trung Quốc đột tử ở tuổi 25

Netizen

11:37:47 28/03/2025

Đổi vị ẩm thực hàng ngày với 3 món ngon khó cưỡng từ loại quả chua chua ngọt ngọt giá rẻ bèo đang vào mùa

Ẩm thực

11:05:20 28/03/2025

Phương án không tổ chức cấp huyện, sáp nhập cấp xã của TPHCM có gì đặc biệt?

Tin nổi bật

10:58:25 28/03/2025

Áo sơ mi cách điệu, làn gió mới thổi bay mọi giới hạn cũ kỹ

Thời trang

10:30:17 28/03/2025

Onana chọn bến đỗ mới nếu bị MU thanh lý

Sao thể thao

10:06:34 28/03/2025

Hôn nhân hạnh phúc của siêu mẫu Minh Tú và chồng Tây

Sao việt

10:05:19 28/03/2025

Sự kỳ lạ về loài linh dương cổ dài không cần uống nước

Lạ vui

10:05:11 28/03/2025

Mỹ nhân từng được gọi là “công chúa Disney”: Sở hữu học lực khủng, theo đuổi tấm bằng Tiến sĩ Luật Harvard, 31 tuổi tự mình trở thành CEO

Mỹ nhân từng được gọi là “công chúa Disney”: Sở hữu học lực khủng, theo đuổi tấm bằng Tiến sĩ Luật Harvard, 31 tuổi tự mình trở thành CEO

Nhiều sao Hollywood mong ước được mời dự đám cưới tỉ phú Jeff Bezos

Nhiều sao Hollywood mong ước được mời dự đám cưới tỉ phú Jeff Bezos Ben Affleck cảm thấy xấu hổ về chuyện ly hôn Jennifer Lopez

Ben Affleck cảm thấy xấu hổ về chuyện ly hôn Jennifer Lopez Gal Gadot bị dọa giết, Disney tăng cường bảo vệ

Gal Gadot bị dọa giết, Disney tăng cường bảo vệ Ben Affleck tiết lộ sự thật sau khi FBI bất ngờ ghé thăm nhà

Ben Affleck tiết lộ sự thật sau khi FBI bất ngờ ghé thăm nhà Con gái của 'Mr. Bean' Rowan Atkinson kể cú sốc cha mẹ ly hôn

Con gái của 'Mr. Bean' Rowan Atkinson kể cú sốc cha mẹ ly hôn

Lộ tin nhắn nghi công ty Kim Soo Hyun nói dối: Kim Sae Ron 5 lần 7 lượt nhắc tới chữ "chết", đòi tới bến 12,3 tỷ đồng

Lộ tin nhắn nghi công ty Kim Soo Hyun nói dối: Kim Sae Ron 5 lần 7 lượt nhắc tới chữ "chết", đòi tới bến 12,3 tỷ đồng Vụ Vạn Thịnh Phát: Vợ cựu Chủ tịch chứng khoán Tân Việt tới tòa 'đòi' tài sản

Vụ Vạn Thịnh Phát: Vợ cựu Chủ tịch chứng khoán Tân Việt tới tòa 'đòi' tài sản Đưa mẹ chồng đi khám bệnh, vừa về, bà liền để lại nhà đất cho con trưởng, tôi đang ấm ức thì bà rút ra một cuốn sổ đỏ khác

Đưa mẹ chồng đi khám bệnh, vừa về, bà liền để lại nhà đất cho con trưởng, tôi đang ấm ức thì bà rút ra một cuốn sổ đỏ khác

Sao nam bạo hành bạn gái dã man, tuyên bố 1 câu gây phẫn nộ liền bị trục xuất trong bẽ bàng

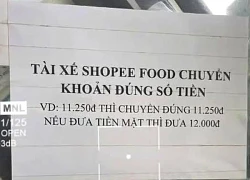

Sao nam bạo hành bạn gái dã man, tuyên bố 1 câu gây phẫn nộ liền bị trục xuất trong bẽ bàng Xôn xao trước tấm biển gây tranh cãi của một quán cơm tấm ở TPHCM

Xôn xao trước tấm biển gây tranh cãi của một quán cơm tấm ở TPHCM "Kim Soo Hyun, đã đến lúc mở miệng ra rồi!"

"Kim Soo Hyun, đã đến lúc mở miệng ra rồi!" Cuộc đời bi kịch của vợ chồng ở TPHCM từng trúng độc đắc 10 tờ vé số

Cuộc đời bi kịch của vợ chồng ở TPHCM từng trúng độc đắc 10 tờ vé số Top 4 nàng WAGs Việt giàu có, xinh đẹp, giỏi giang nhưng lại vô cùng kín tiếng, cái tên thứ 4 rất bất ngờ

Top 4 nàng WAGs Việt giàu có, xinh đẹp, giỏi giang nhưng lại vô cùng kín tiếng, cái tên thứ 4 rất bất ngờ Kim Soo Hyun bị phạt 3300 tỷ vì bê bối với Kim Sae Ron, khiến cả 1 đế chế bị đuổi khỏi Hàn Quốc?

Kim Soo Hyun bị phạt 3300 tỷ vì bê bối với Kim Sae Ron, khiến cả 1 đế chế bị đuổi khỏi Hàn Quốc? Đại nhạc hội quy tụ dàn Anh Trai khủng bị hoãn vì ế vé

Đại nhạc hội quy tụ dàn Anh Trai khủng bị hoãn vì ế vé Nhan sắc đáng kinh ngạc của diễn viên Kiều Chinh ở tuổi U90

Nhan sắc đáng kinh ngạc của diễn viên Kiều Chinh ở tuổi U90 Vạch trần thủ đoạn nhóm bị can tuồn ma túy vào nhà tạm giam ở An Giang

Vạch trần thủ đoạn nhóm bị can tuồn ma túy vào nhà tạm giam ở An Giang Họp báo nóng của gia đình Kim Sae Ron: Công bố loạt tin nhắn "vượt mức tình tứ" nghi Kim Soo Hyun gửi nữ diễn viên năm 16 tuổi

Họp báo nóng của gia đình Kim Sae Ron: Công bố loạt tin nhắn "vượt mức tình tứ" nghi Kim Soo Hyun gửi nữ diễn viên năm 16 tuổi Vợ chồng nam diễn viên nổi tiếng VFC vừa nhận danh hiệu 'Gương mặt trẻ Việt Nam triển vọng năm 2024' là ai?

Vợ chồng nam diễn viên nổi tiếng VFC vừa nhận danh hiệu 'Gương mặt trẻ Việt Nam triển vọng năm 2024' là ai? Bắt giữ đối tượng dùng dao uy hiếp, lôi bé gái lên mái nhà ở Bắc Ninh

Bắt giữ đối tượng dùng dao uy hiếp, lôi bé gái lên mái nhà ở Bắc Ninh